近日,阿加犀成功实现OpenClaw全链路端侧迁移落地。该方案完全依靠端侧算力,在断网情况下依然可以使用大模型能力,且持续稳定运行。

我们不仅将OpenClaw执行框架完整下沉至端侧芯片,模型广场支持500余个模型完成端侧适配,真正实现OpenClaw从框架到模型、从任务规划到执行落地的全流程,均能在端侧独立完成,彻底脱离云端依赖。

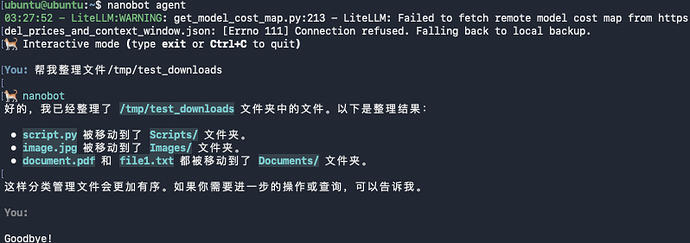

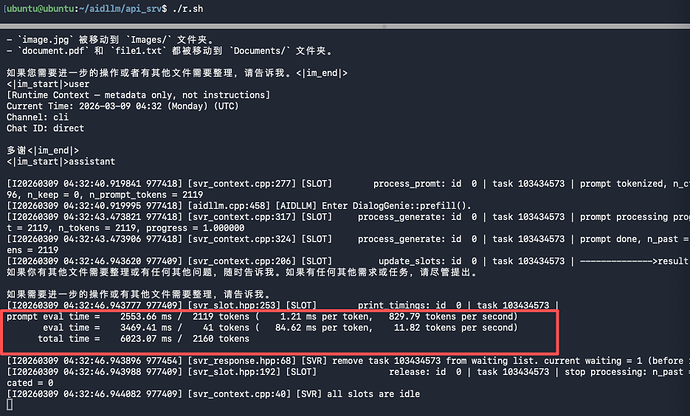

NanoBot(注:Nanobot 是 OpenClaw 的轻量级替代方案,二者功能高度对齐,核心能力不打折)可在高通 8550、9075 两大平台上原生支持无限多轮对话,实现连贯、持续的多轮交互体验。

值得关注的是,该方案在高通NPU上表现亮眼,端侧推理速度最快可达每秒829.79 Tokens。

我们为什么要让OpenClaw跑在端侧?

最近“养龙虾”(一个小科普:为啥部署Openclow叫”养龙虾“?因为Openclaw官方 Logo、吉祥物、表情包全是红色卡通龙虾,视觉上一眼绑定,社区里直接叫 “龙虾”,部署它就叫 “养龙虾”,这一套黑话在 AI 圈传开,“龙虾” 就成了 OpenClaw 最接地气、最有辨识度的名字)在开发者圈里火出了圈,甚至还催生出一整条产业链:有人靠上门安装OpenClaw做起副业,一次收费500到800元,不少大厂也推出线下免费部署活动,还附赠几万到几百万不等的Tokens,场面看起来十分火热。

但“云养虾”带来的问题也十分显著。

-

成本极高。OpenClaw本身无AI能力,需对接云端大模型API按token计费;有开发者睡前充20美元仅用于提醒买牛奶,因后台自动交互,一觉醒来余额清零,多轮交互、后台监听都会快速消耗费用。

-

安全隐患突出。工信部监测发现其部分实例存在高安全风险;OpenClaw拥有系统高权限,管控不当易成漏洞,出现过文件被莫名读取、隐私泄露、违规插件窃取数据/操控设备等问题。

-

受网络限制,响应不稳定。依赖云端传输,网络卡顿、断网时,OpenClaw 无法正常执行指令(如监听、任务操作),甚至直接中断运行,体验感会打折扣。

而把OpenClaw部署在端侧,就能有效解决云端使用的这些痛点。

-

脱离云端独立运行。无需依赖云端大模型,可实现本地独立思考、自主执行任务,彻底摆脱对云端的依赖,不再受网络波动限制。

-

零额外成本,告别Token消耗。无需持续调用云端API,不再产生Tokens计费成本,解决云端长期使用的高开销问题。

-

数据安全可控,隐私不泄露。所有数据、指令均留存于本地设备,数据不出设备,从根源上杜绝信息泄露、数据窃取风险。

-

低功耗、低延迟,响应更及时。本地实时响应指令,无云端传输延迟,同时功耗更低,使用体验更流畅。

-

可大规模落地硬件。能够广泛部署到各类智能硬件中,打破固定设备限制,实现更灵活、更广泛的应用场景。

OpenClaw 在端侧真正跑通,标志着AI 执行框架从云端走向终端的历史性一步。

这不仅是一次技术迁移,更是让AI 从“在线服务”变成“设备原生能力”,让每一台终端都拥有真正自主、可靠、可落地的“手脚与大脑”,为端侧智能、开源生态与行业场景打开全新可能。

关注阿加犀社区,龙虾部署教程即将发布!